Et si une vidéo du président d’un pays déclarant la guerre… n’avait jamais existé ? Les deepfakes, ces vidéos truquées générées grâce à l’intelligence artificielle, bouleversent notre rapport à la vérité. D’abord utilisés pour l’humour ou le divertissement, ils sont désormais capables d’imiter à la perfection la voix et le visage de personnalités publiques. Cette technologie soulève une question inquiétante : les deepfakes peuvent-ils fragiliser nos démocraties en manipulant l’opinion publique ?

Les deepfakes : une technologie bluffante et inquiétante

Comment fonctionnent les deepfakes ?

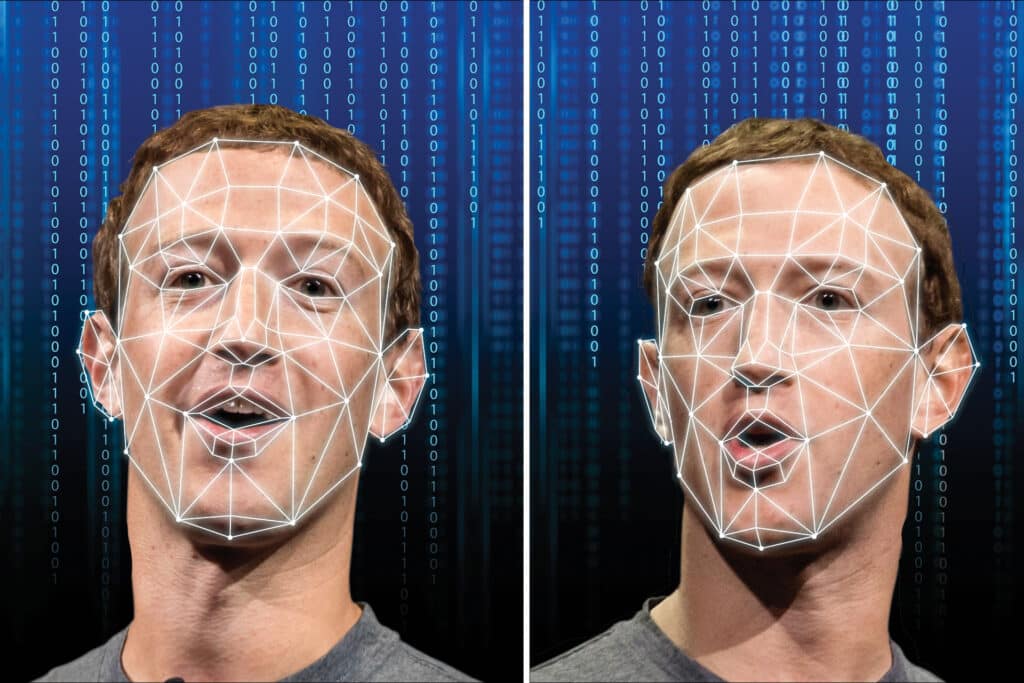

Les deepfakes utilisent des algorithmes d’apprentissage automatique (deep learning) pour superposer et animer des visages ou des voix.

Résultat : une vidéo où un responsable politique peut sembler tenir des propos qu’il n’a jamais prononcés.

Des exemples marquants

- En 2018, une vidéo virale montrait l’ancien président américain Barack Obama insultant Donald Trump : un deepfake produit par un collectif pour alerter sur les dangers de la technologie.

- En 2022, en pleine guerre en Ukraine, un deepfake montrait Volodymyr Zelensky appelant les soldats à déposer les armes. Bien que vite démentie, la vidéo a illustré la puissance de désinformation que représentent ces outils.

Une arme de désinformation politique

Les deepfakes pour manipuler les opinions publiques

Les deepfakes peuvent être utilisés pour :

- diffuser de fausses déclarations politiques,

- créer des scandales fabriqués,

- semer la confusion dans l’opinion.

Dans un contexte électoral, quelques vidéos truquées, mais crédibles peuvent influencer des millions d’électeurs.

Créer un climat de doute généralisé

Même lorsqu’un deepfake est démenti, son impact reste réel. À force de multiplier les fausses vidéos, on installe un climat de méfiance généralisée : plus personne ne sait ce qui est vrai ou faux.

C’est ce qu’on appelle le risque de « l’ère de la post-vérité ».

Une menace prise au sérieux

Les démocraties sur leurs gardes

Aux États-Unis comme en Europe, des lois et des programmes de recherche se multiplient pour détecter les deepfakes.

Des partenariats entre gouvernements, universités et entreprises technologiques cherchent à développer des outils de vérification rapide.

Un défi éthique et technologique

Mais la course est inégale : les algorithmes de détection progressent… mais les créateurs de deepfakes avancent encore plus vite.

De plus, certaines utilisations non politiques (cyberharcèlement, chantage, contenus sexuels truqués) posent déjà de graves problèmes sociaux et juridiques.

La vérité en danger ?

Les deepfakes illustrent une menace inédite : la manipulation de la perception visuelle et auditive, autrefois considérée comme une preuve irréfutable. Pour protéger la démocratie, il faudra développer à la fois des outils technologiques de détection, des lois adaptées, et surtout une éducation citoyenne au numérique. Car dans un monde où tout peut être fabriqué, la vigilance collective devient le dernier rempart contre la désinformation.